LiteRT(Lite Runtime 的缩写)是 TensorFlow Lite (TFLite) 的新名称。虽然这个名字是新的,但它仍然是设备上人工智能的同样值得信赖的高性能运行时,现在具有扩展的视野。

自 2017 年推出以来,TFLite 已助力开发者在约 27 亿台设备上的超 10 万个应用中实现了 ML 驱动的体验。最近,TFLite 的发展已经超越了其最初的 TensorFlow 基础,开始支持用 PyTorch、JAX 和 Keras 编写的模型,并提供同样的领先性能。LiteRT 这个名称体现了面向未来的多框架愿景:使开发者能够以任何流行的框架开始构建,并在设备端以卓越的性能运行其模型。

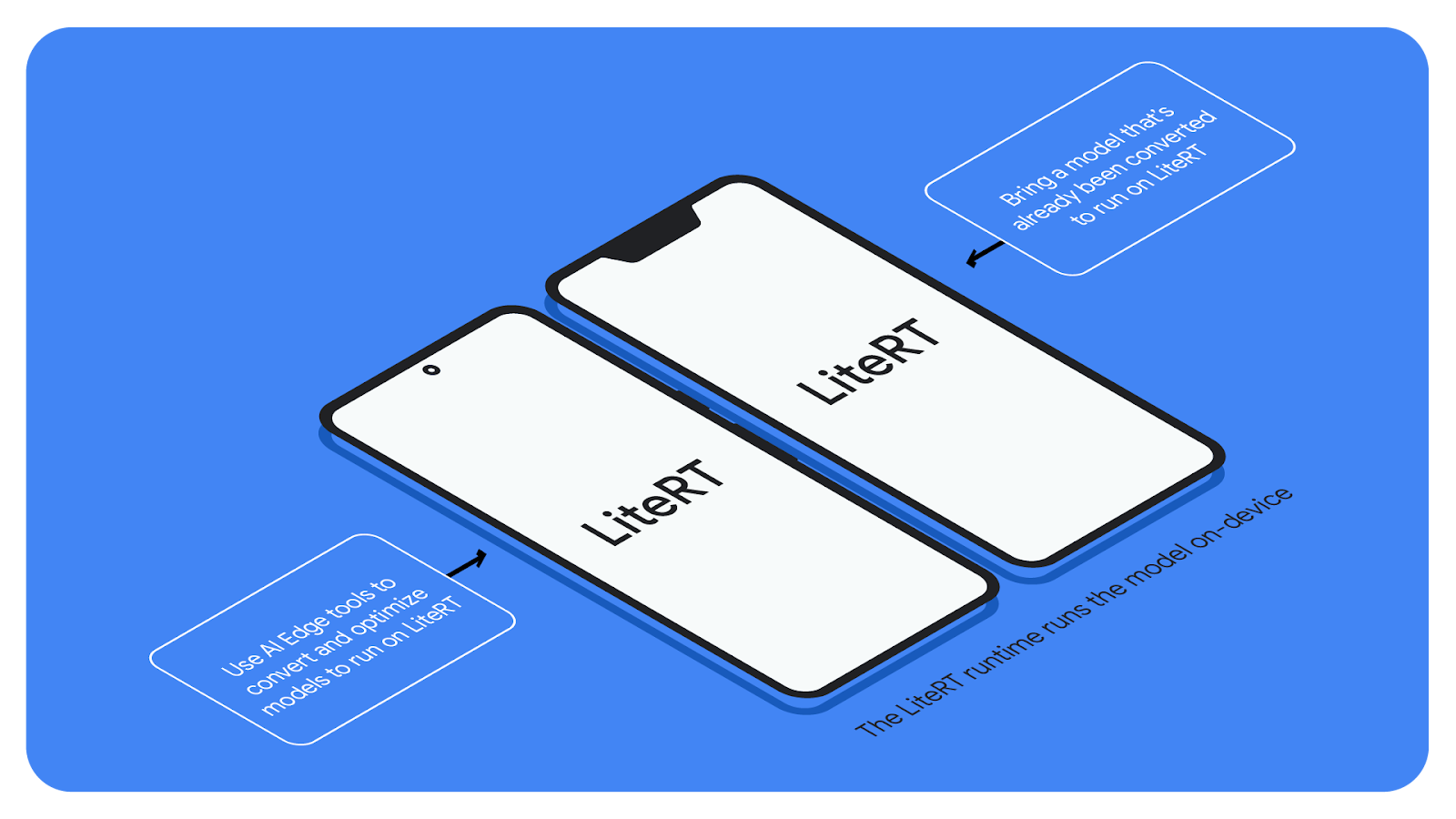

LiteRT 是 Google AI Edge 工具套件的一部分,可让您在 Android、iOS 和嵌入式设备上无缝部署 ML 与 AI 模型的运行库。借助 AI Edge 强大的模型转换和优化工具,您可以为设备端开发同时准备好开源模型和自定义模型。

名称更改将逐步推出。从今天开始,您将在开发者文档中看到 LiteRT 的名称,这些文档将迁移到 ai.google.dev/edge/litert,同时您还将在 AI Edge 网站的其他引用中看到这一变化。原本位于 tensorflow.org/lite 的文档现在会重定向到 ai.google.dev/edge/litert 上的相应页面。

主要的 TensorFlow 品牌不会受到影响,已经使用 TensorFlow Lite 的应用也不会受到影响。

我们的目标是将此更改的影响降至最低,尽可能减少开发者对代码的改动。

如果您目前通过软件包使用 TensorFlow Lite,则需要更新任何依赖项才能使用来自 Maven、PyPi 和 Cocoapods 的新 LiteRT。

如果您目前通过 Google Play 服务使用 TensorFlow Lite,则当前无需做任何更改。

如果您目前从源代码构建 TensorFlow Lite,请继续从 TensorFlow 代码库进行构建,直到代码在今年晚些时候完全迁移到新的 LiteRT 代码库为止。

1. 除了新名称 LiteRT 之外,还有什么变化?

目前,唯一的变化就是新名称 LiteRT。您的生产应用不会受到影响。随着新名称和愿景的公布,LiteRT 将会迎来更多更新,以提升您在不同平台上部署经典 ML 模型、LLM 和扩散模型时的 GPU 及 NPU 加速体验。

2. TensorFlow Lite 支持库(包括 TensorFlow Lite 任务)会发生什么变化?

目前,TensorFlow Lite 支持库和 TensorFlow Lite 任务将保留在 /tensorflow 代码库中。我们鼓励您在未来的开发中使用 MediaPipe 任务。

3. TensorFlow Lite Model Maker 会发生什么变化?

您可以继续通过 https://pypi.org/project/tflite-model-maker/ 访问 TFLite Model Maker

4. 如果我想贡献代码,该怎么办?

目前,请在现有的 TensorFlow Lite 代码库中贡献代码。当我们准备好接受对 LiteRT 代码库的贡献时,我们会另行通知。

5. .tflite 文件扩展名和文件格式会发生什么变化?

.tflite 文件扩展名或格式将保持不变。转换工具将继续输出 .tflite 扁平缓冲区文件,且 .tflite 文件可以被 LiteRT 读取。

6. 如何将模型转换为 .tflite 格式?

对于 Tensorflow、Keras 和 Jax,您可以继续使用相同的流。有关 PyTorch 支持,请查看 ai-edge-torch。

7. 类和方法会有任何变化吗?

不会。除了软件包名称外,您不必更改目前编写的任何代码。

8. TensorFlow.js 会有任何变化吗?

不会,TensorFlow.js 将继续作为 Tensorflow 代码库的一部分独立运行。

9. 我的生产应用使用了 TensorFlow Lite,是否会受到影响?

已部署 TensorFlow Lite 的应用不会受到影响,包括通过 Google Play 服务访问 TensorFlow Lite 的应用。(由于 TFLite 是在构建时编译进应用中的,因此一旦部署,应用就没有依赖项。)

10. 为什么选择“LiteRT”?

“LiteRT”(Lite Runtime 的缩写)反映了 TensorFlow Lite(一种开创性的“lite”设备上运行时)的传统,以及 Google 对支持当今蓬勃发展的网络的承诺。多框架生态系统。

11. TensorFlow Lite 是否仍在积极开发中?

是的,但其名称现已变更为 LiteRT。运行库(现称为 LiteRT)以及转换和优化工具的开发工作仍在继续。为了确保您使用的是最新版本的运行库,请使用 LiteRT。

12. 在哪里可以看到 LiteRT 的实际应用示例?

您可以在官方的 LiteRT 示例代码库中找到 Python、Android 和 iOS 的示例。

我们对设备端 ML 的未来充满期待,并致力于实现我们的愿景:让 LiteRT 成为最易使用、性能最强、适用于多种模型的运行库。